Plusieurs mois de développement et après une année depuis la dernière version, une nouvelle version du module PowerArubaCP est disponible ! Mais avant tout c’est quoi PowerArubaCP ? C’est un module PowerShell qui utilise l’API REST de ClearPass Policy Manager d’Aruba ! ClearPass est le super serveur RADIUS et gestion des invités d’Aruba/HPE. Il permet l’authentification en 802.1x/MAC/Web des équipements …

automatisation

Next VMUG – 26 Septembre 2019 – Save this date

Le VMUG (VMware User Group) de la rentrée 2019, c’est le rendez-vous annuel incontournable à ne pas manquer ! Cormac Hogan, Niels Haggort seront également présents…

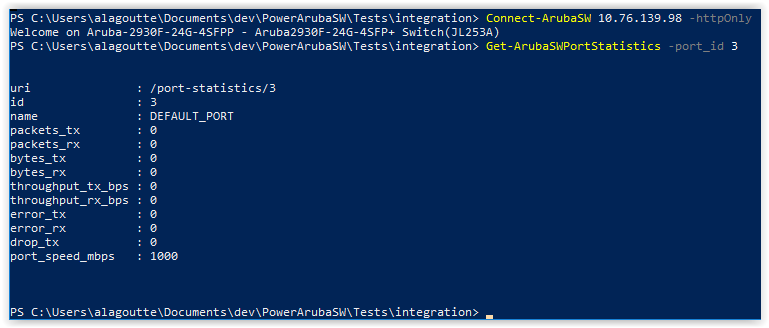

Présentation de PowerArubaSW

Depuis un certain nombre d’année, de multiples équipements réseaux sont pilotables avec les API REST Full. La plupart du temps, des exemples d’utilisation de ces API sont disponibles en python. Mais dans le monde de l’admin system, on retrouve régulièrement des implémentations utilisant PowerShell (PowerCLI pour VMware, Unity-powershell pour les baies EMC Unity …) qui ont l’avantage d’être plus accessible, …

L’admin de demain ! [ Introduction ]

Cela n’aura échappé à personne mais nous vivons une époque de profonds changements dans notre métier. De nombreuses nouvelles technologies venant bousculer nos habitudes d’Administrateur Datacenter ou étant sur le point de le faire. J’avais envie de partager avec vous ma réflexion sur le sujet. Je me rappelle régulièrement cette phrase lorsque que j’effectue une étude technique : « Nous faisons partie du …

UNITY- POWERSHELL : THE FIRST STEPS TO AUTOMATION

Interview by Erwan Quelin: made in Nantes develops scripts for UNITY Dell EMC arrays. Interview with Erwan Quelin about the development of his PowerShell module Erwan, based in Nantes, has been a Systems engineer at Cheops Technology for 6 years. He works in multiple ways with a wide variety of clients in the Western region. A specialist in virtualization with …

Unity-Powershell : Les premiers pas vers l’automatisation

Interview d’Erwan Quelin : made in Nantes développe des scripts pour les baies UNITY Dell EMC. Entretien avec Erwan Quélin sur le développement de ton module PowerShell Basé sur Nantes, Erwan est depuis près de 6 ans Ingénieur Systèmes chez Cheops Technology. Ses interventions sont multiples et auprès de clients très diversifiés dans la région Ouest. Spécialisé dans la virtualisation …